Retour aux projets

★ Featurednlp-genaimars 2026

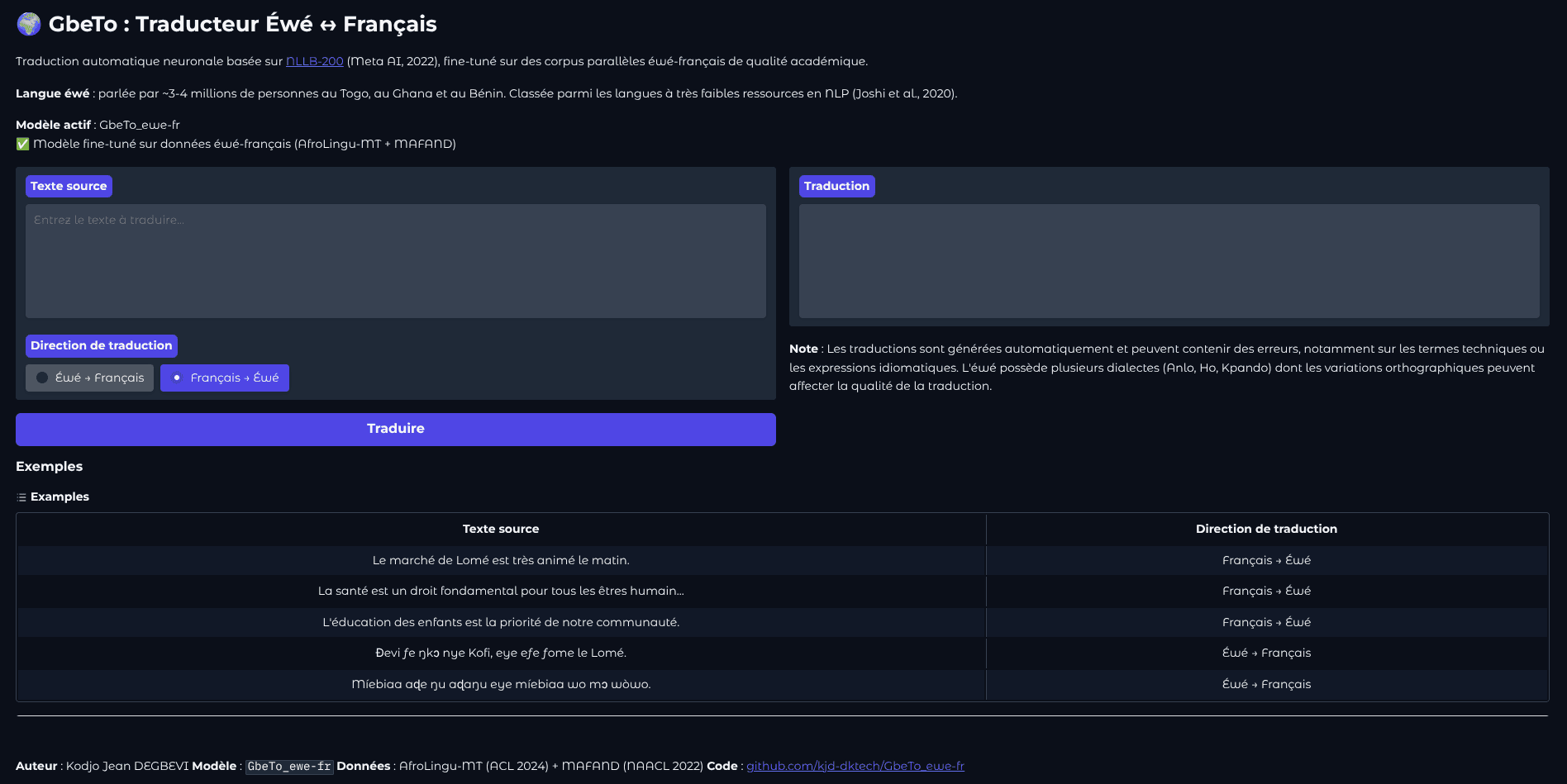

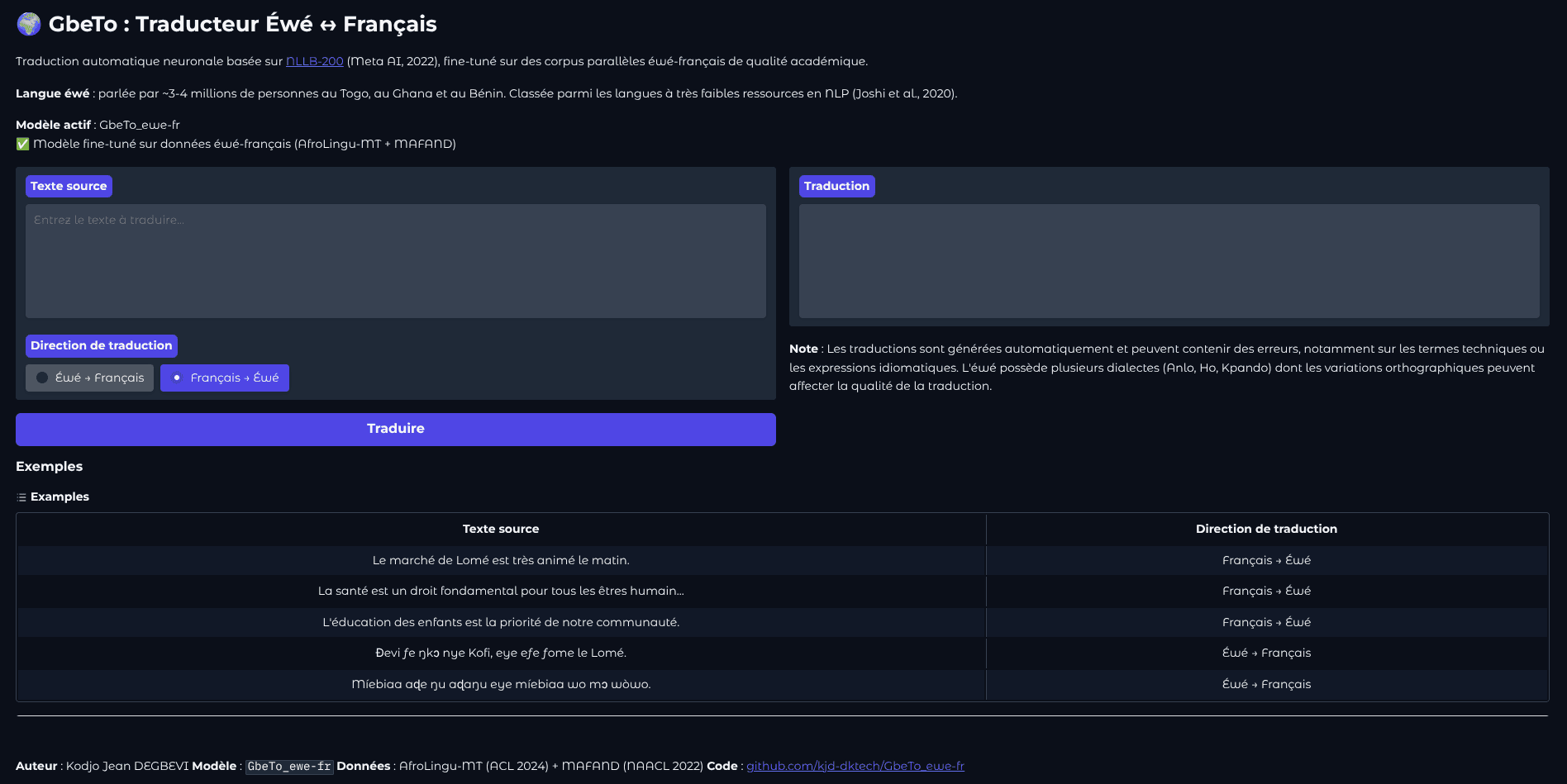

GbeTo — Traducteur Ewé ↔ Français

Fine-tuning du modèle NLLB-200-distilled-600M (Meta AI) pour la traduction neurale bidirectionnelle Ewé ↔ Français — NLP pour une langue africaine à faibles ressources.

// description détaillée

Fine-tuning du modèle de traduction automatique neurale NLLB-200-distilled-600M de Meta AI pour la traduction bidirectionnelle entre l'Ewé (langue gbe d'Afrique de l'Ouest à faibles ressources, ma langue maternelle) et le Français. Le projet couvre : - Collecte et prétraitement d'un corpus parallèle Ewé–Français - Fine-tuning avec l'API Hugging Face Trainer (PyTorch back-end) - Évaluation quantitative avec la métrique sacrebleu (score BLEU) - Déploiement d'une démo interactive sur Hugging Face Spaces via Gradio - Publication du modèle fine-tuné sur le Hub Hugging Face Résultat : score BLEU passé de 13,41 (baseline) à 16,70 après fine-tuning, soit une amélioration de +24,5 %.

// stack technique

PythonPyTorchHuggingFace TransformersNLLB-200seq2seqsacrebleuGradio

// tags

#NLP#traduction automatique#langues africaines#Ewé#fine-tuning#transformers#low-resource